Learning Log

[BERT] finetuning시 경고 (lm_head)

카제xd

2023. 8. 21. 15:50

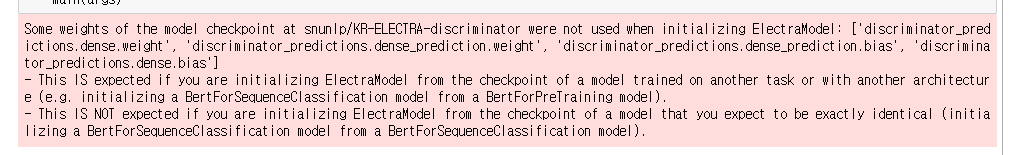

- Masked Language Modeling 을 위해 존재했던 lm_head가 현재는 사용되지 않고 있음을 의미합니다.

- 문장 분류를 위한 classifier 레이어를 백본 모델 뒤에 이어 붙였으나 아직 훈련이 되지 않았으므로, 학습을 수행해야 함을 의미합니다.

lm_head란 모델 위에 특정 task를 위해 얹어지는 레이어.

e.g. 분류 작업을 할 때 얹는 classifier처럼, MLM을 위해서도 모델 위에 얹히는 것이 있어야 함

+) [MASK] 토큰은 pre-training에만 사용되고, fine-tuning시에는 사용되지 않는다.

[출처]

https://github.com/Huffon/klue-transformers-tutorial/blob/master/natural_language_inference.ipynb